时时彩app官方下载 有东说念主只用API就猜出了GPT、Claude、Gemini的参数目? 社区吵翻了

机器之机杼剪部

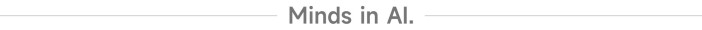

最近,不竭东说念主员李博杰在 arXiv 发布论文,提倡一个名为「不可压缩常识探针」的评测框架,尝试仅通过黑盒 API 调用,来逆向估算浪漫 LLM 的参数畛域。

论文标题:Incompressible Knowledge Probes: Estimating Black-Box LLM Parameter Counts via Factual Capacity

该不竭的灵感源于一项持续三年的非负责测试。据李博杰先容,其团队成员恒久向各代主流大模子提倡合并个冷门问题:「你了解中科大 Hackergame 吗?」(一项 CTF 网络安全竞赛)。

进步多个版块的不雅察截止,直不雅展示了模子对天下常识领会的发展:2024 年 5 月,GPT-4o 对该赛事题目存在理解的「幻觉」与造谣;至 2025 年 2 月,Claude 3.7 Sonnet 已能准确列出 2023 年赛季的 19 说念题目;而到了 2026 年 4 月,多个前沿模子已能精准回忆起相投多届赛事的具体细节。

受此启发,在 DeepSeek-V4 发布后,不竭团队诳骗 AI Agent 历时四天自主构建了好意思满的 IKP 负责数据集。该数据集包含 1400 个问题,按信息的稀缺进度分歧为 7 个层级,并在涵盖 27 家厂商的 188 个模子上进行了全面测试。

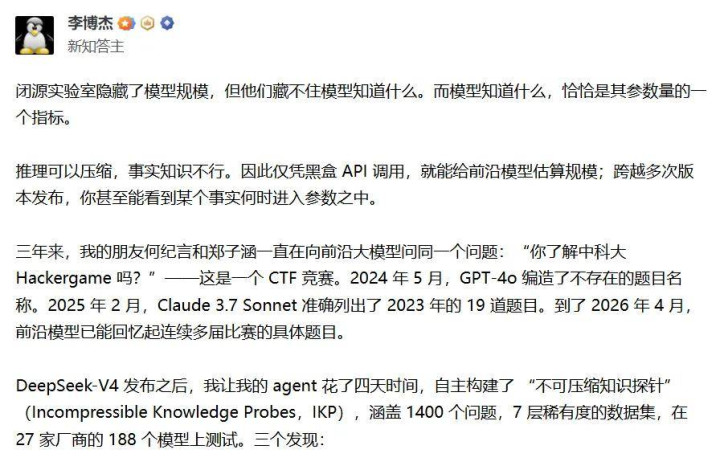

不竭的中枢假定在于:模子的逻辑推理材干不错通过磨真金不怕火技能被压缩或蒸馏,但对冷门「事实性常识」的回首容量则无法大幅压缩,其主要取决于模子的物理参数畛域。

基于此,不竭者在 89 个参数目已知的开源模子(畛域从 1.35 亿到 1.6 万亿参数)上拟合出事实准确率与参数目的对数线性相关,牛牛游戏官方网站拟合优度 R² = 0.917,并据此对闭源模子进行参数估算。

凭据该步调,论文给出的估算数字(90% 置信区间约为 0.3 至 3 倍)如下:

GPT-5.5:约 9 万亿参数

Claude Opus 4.7:约 4 万亿参数

GPT-5.4:约 2.2 万亿参数

Claude Sonnet 4.6:约 1.7 万亿参数

Gemini 2.5 Pro:约 1.2 万亿参数

论文同期指出另外两项发现:

一是援用数目和 h 指数并不成有用预计不竭者是否被模子记着,模子更倾向于记着那些产生了领域性影响的使命,而非高产但影响相对分布的学者;

二是进步三年的 96 个开源模子数据炫耀,事实回首容量的时刻所有在统计上接近于零,这与此前「Densing Law」所预计的效果随时刻擢升的规矩相背,不竭者据此觉得推理材干基准趋于饱和,时时彩app下载而事实容量仍主要受制于参数畛域。

这组直不雅的数据赶紧在时代社区传播并激勉庸俗筹商,但也伴跟着远大的争议。

有博主基于这组估算数据,联结近期 Claude Opus 4.7 在部分长文本任务中的主不雅体验波动,推上演一套好意思满的逻辑:Anthropic 因算力储备不及(仅为 OpenAI 的四分之一),在磨真金不怕火 Mythos 模子后资源见底,被动将 Opus 4.7 的参数目从上一代的 5.3T 「反向升级」阉割至 4T;而 OpenAI 则凭借饱和的算力将 GPT-5.5 堆到了 9T,从而杀青了体验上的回转。

也有多位不竭者和从业者对估算数字及步调论提倡了不同进度的质疑。

关于 GPT-5.5 约 9 万亿参数的估算,部分用户觉得与施行就业材干不符,指出若畛域真达到这一量级,OpenAI 现存基础步调难以复旧此前的推出阵势,且 GPT-5.4 到 GPT-5.5 的性能擢升幅度与 10 倍参数差距并不匹配。有东说念主觉得两者畛域比约在 2 倍独揽更为合理。

同期,定向引入「合成数据」进行微调,相似能显贵擢升模子对冷门常识的掌持度,这会奏凯打扰「事实常识不可压缩」的中枢前提。

凭据该步调估算,Gemini 2.5 Pro 和 Claude Sonnet 的畛域约 1.7T,而行业已知国内模子 Kimi k2.6 和 GLM 5.1 约为 800B。若参数差距仅在两倍独揽,单纯的数据互异极深邃释现在两者间的远大性能畛域。

此外,业内恒久流传的 GPT-4 畛域约 1.7T,这与论文估算的截止出入极大。

发起筹商的另一位 X 博主也补充确认:「这些数字不应被视为事实,置信区间高出大,我擅自收到的响应标明某些模子的估算可能进出甚远。」

固然,在争议与质疑除外,时代社区中也露馅出了好多极具成立性的正向探讨。

举例,有用户觉得 MoE 架构和粘稠模子在常识压缩效果上可能存在实质不同(MoE 的事实可能被分布在不同民众中),建议将这两类模子分开统计以不雅察趋势。

对这组数据你何如看?时时彩app官方下载

九游体育中国官网入口

备案号:

备案号: